Cảnh báo thủ đoạn lừa đảo sao chép giọng nói bằng AI

Thứ 4, 16/10/2024 | 18:47:56

817 lượt xem

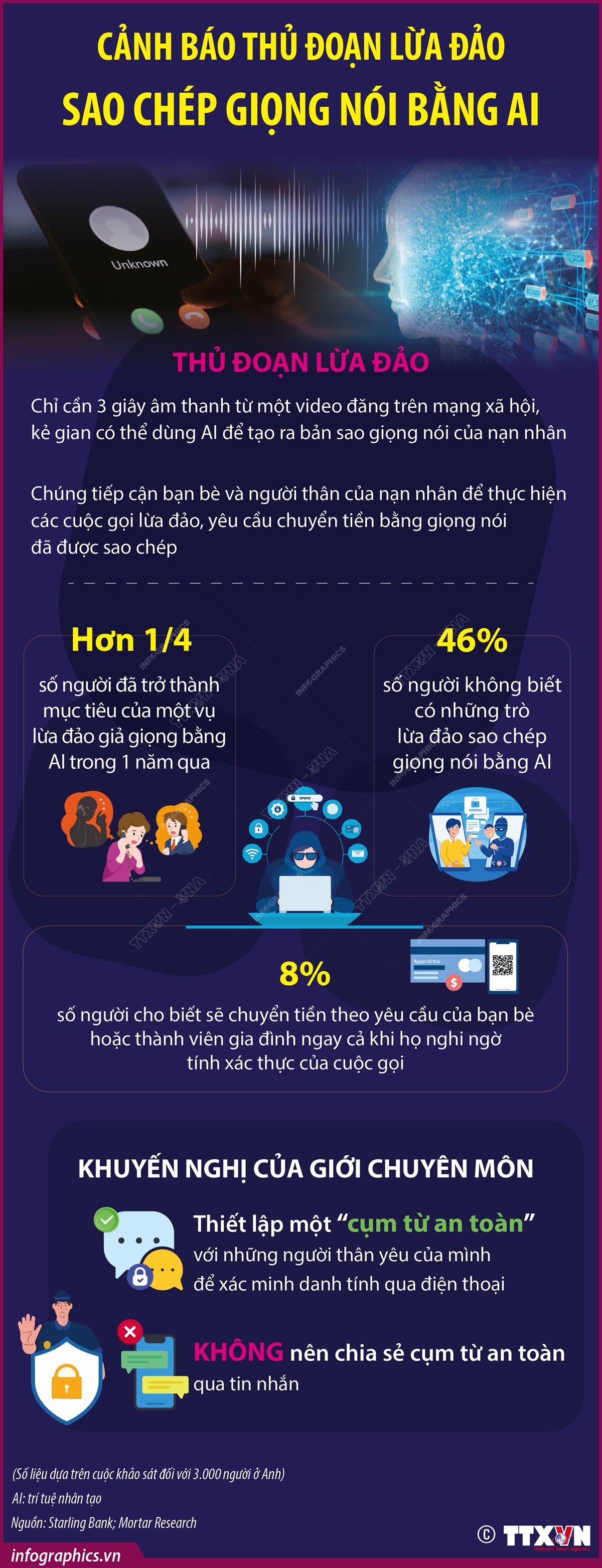

Các chuyên gia công nghệ cảnh báo hàng triệu người có thể bị lừa bởi những kẻ sử dụng công nghệ trí tuệ nhân tạo (AI) để sao chép giọng nói. Chỉ cần 3 giây âm thanh từ một video đăng trên mạng xã hội, kẻ gian có thể dùng AI để tạo ra bản sao giọng nói của nạn nhân. Sau đó, chúng tiếp cận bạn bè và người thân của họ để thực hiện các cuộc gọi lừa đảo, yêu cầu chuyển tiền bằng giọng nói đã được sao chép.

Theo TTXVN

Tải thêm

Tin cùng chuyên mục

- Tình hình bệnh truyền nhiễm tại Thái Bình 21.05.2025 | 10:06 AM

- Cầu mây Việt Nam giành tấm Huy chương Vàng lịch sử 23.03.2025 | 16:09 PM

- Các Tiểu Vương quốc Arab Thống nhất (UAE): 5 trọng tâm hợp tác trong thời gian tới 29.10.2024 | 16:43 PM

- Những lưu ý người dân khi xảy ra lũ, lụt 28.10.2024 | 16:03 PM

- Ngày hội Văn hóa dân tộc Chăm lần thứ VI tại tỉnh Ninh Thuận, năm 2024 16.09.2024 | 21:16 PM

- Một số nguyên tắc bảo đảm an toàn thực phẩm sau lũ lụt 13.09.2024 | 18:11 PM

- Viện trưởng Viện kiểm sát nhân dân tối cao Nguyễn Huy Tiến 27.08.2024 | 14:34 PM

- Ủy viên Trung ương Đảng, Phó Thủ tướng Chính phủ, Bộ trưởng Bộ Tài chính Hồ Đức Phớc 27.08.2024 | 14:34 PM

- Ủy viên Trung ương Đảng, Phó Thủ tướng Chính phủ, Bộ trưởng Bộ Ngoại giao Bùi Thanh Sơn 27.08.2024 | 10:12 AM

- Giải thưởng “Công nghệ từ trái tim - Technology with heart” Các tác giả, tác phẩm đoạt giải ảnh bộ 05.06.2024 | 18:28 PM

Xem tin theo ngày

-

Đặc sắc chương trình nghệ thuật kỷ niệm 110 năm ngày sinh Tổng Bí thư Nguyễn Văn Linh và chào mừng hợp nhất tỉnh Hưng Yên và tỉnh Thái Bình

Đặc sắc chương trình nghệ thuật kỷ niệm 110 năm ngày sinh Tổng Bí thư Nguyễn Văn Linh và chào mừng hợp nhất tỉnh Hưng Yên và tỉnh Thái Bình

- Chủ tịch Ủy ban Trung ương MTTQ Việt Nam Đỗ Văn Chiến thăm làm việc tại phường Phố Hiến

- Công bố nghị quyết, quyết định của Trung ương, địa phương về sáp nhập đơn vị hành chính cấp tỉnh, cấp xã và kết thúc hoạt động cấp huyện

- Báo Thái Bình - Một hành trình với những mốc son lịch sử

- Thư tòa soạn

- Công bố quyết định của Bộ trưởng Bộ Công an, Giám đốc Công an tỉnh về công tác tổ chức, cán bộ

- Khởi công dự án nhà máy đốt chất thải rắn phát điện công nghệ hiện đại tại xã Thụy Trình

- Khởi công dự án đầu tư xây dựng sân golf Cồn Vành và dự án đầu tư xây dựng khu bến cảng hàng lỏng Ba Lạt

- Việt Nam nâng tầm vị thế tại Hội nghị quốc tế về biển và đại dương

- Hội thảo khoa học: Đồng chí Nguyễn Văn Linh – Nhà lãnh đạo kiên định, sáng tạo của Đảng và cách mạng Việt Nam